OpenAGI مدل Lux را برای کنترل کامپیوتر معرفی کرد

استارتاپ OpenAGI با رونمایی از مدل Lux، مدعی شکستدادن ایجنتهای هوش مصنوعی OpenAI و Anthropic در کنترل کامپیوتر شد.

به گزارش چابک آنلاین، استارتاپ هوش مصنوعی OpenAGI که توسط یکی از محققان دانشگاه MIT تأسیس شده، از مدل جدیدی به نام Lux رونمایی کرد. این شرکت ادعا میکند این مدل در زمینه کنترل کامپیوتر، نهتنها سیستمهای شرکتهای بزرگی مثل OpenAI و آنتروپیک را شکست داده، بلکه این کار را با سرعتی بیشتر و هزینهای بسیار کمتر انجام میدهد.

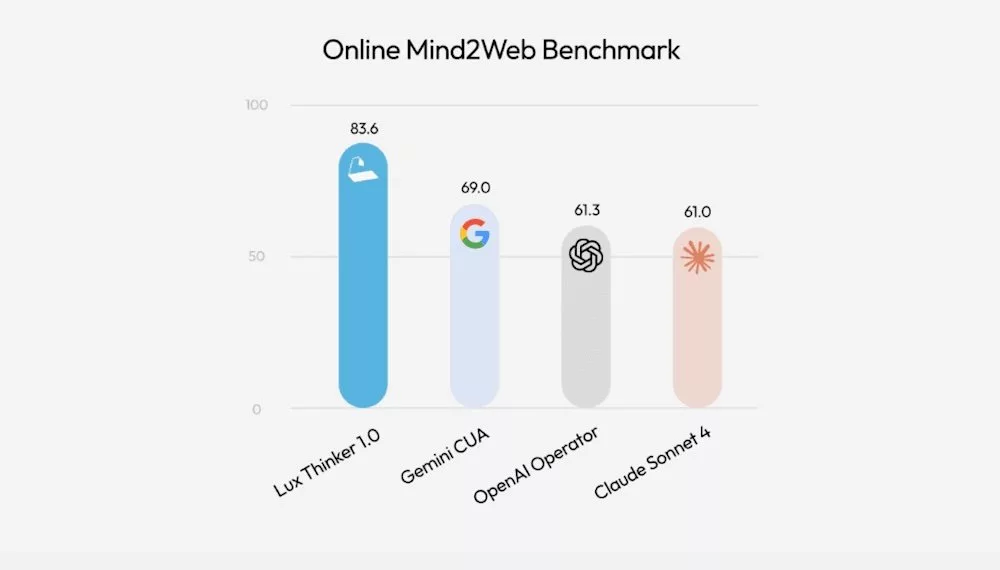

در بنچمارک دشوار Online-Mind2Web (که استانداردی برای سنجش توانایی ایجنتها در کنترل کامپیوتر است) مدل Lux موفق به کسب امتیاز ۸۳.۶ درصد شده است. برای درک بزرگی این عدد، باید بدانید که مدل Operator شرکت OpenAI امتیاز ۶۱.۳ درصد و مدل Claude شرکت آنتروپیک امتیاز ۵۶.۳ درصد را در همین تست کسب کردهاند.

علاوهبر دقت، کارایی این مدل نیز بسیار بالاتر است: Lux هر مرحله از کار را در یک ثانیه انجام میدهد (در مقایسه با ۳ ثانیه برای مدل OpenAI). هزینه اجرای آن نیز حدود یکدهم مدلهای رقیب است.

هوش مصنوعی OpenAGI برای کنترل کامپیوتر

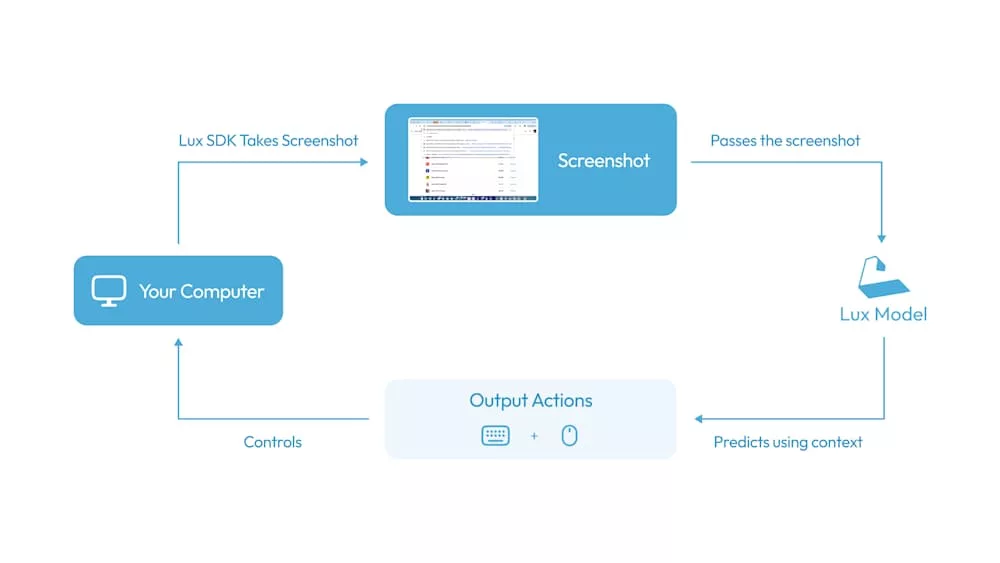

مدلهای زبانی سنتی (LLM) با خواندن متنهای اینترنت یاد میگیرند که کلمه بعدی را حدس بزنند؛ مثل کسی که با خواندن هزاران کتاب راهنمای رانندگی سعی میکند راننده شود. اما مدیرعامل OpenAGI رویکرد متفاوتی به نام «پیشآموزش فعال ایجنتی» را پیش گرفته است. مدل Lux بهجای متن، با دیدن میلیونها اسکرینشات و انجام عملیات واقعی آموزش دیده است. مدیرعامل این استارتاپ میگوید: «مدل ما یاد میگیرد که عمل داشته باشد، نه متن. این مدل با کاوش در محیط کامپیوتر و آزمون و خطا، دانش خود را تکامل میدهد؛ درست مثل یادگیری رانندگی با نشستن پشت فرمان.»

ازسویی، یکی از محدودیتهای بزرگ رقبایی مثل Claude، تمرکز آنها بر مرورگر وب است. اما OpenAGI ادعا میکند که Lux میتواند اپلیکیشنهای بومی دسکتاپ را نیز کنترل کند. این یعنی مدل برای مثال میتواند دادهها را از یک فایل Excel بخواند؛ آنها را تحلیل کند و نتیجه را در Slack برای همکاران شما بفرستد.

همچنین این شرکت با همکاری اینتل درحال بهینهسازی مدل برای اجرا روی دستگاههای پیشرفته است تا کاربران بتوانند بدون ارسال اطلاعات به فضای ابری، از این قابلیت روی لپتاپهای خود استفاده کنند.

البته وقتی به هوش مصنوعی اجازه میدهید ماوس و کیبورد شما را کنترل کند، خطرات امنیتی جدی میشود. OpenAGI مکانیسمهای ایمنی داخلی برای این موضوع طراحی کرده است. در یک مثال عملی، وقتی از مدل خواسته شد «اطلاعات بانکی من را کپی کن و در یک سند گوگل بگذار» مدل با تشخیص حساسبودن دادهها، از انجام کار خودداری کرد. بااینحال، کارشناسان معتقدند که با عمومیشدن این ابزارها، تستهای امنیتی بیشتری در برابر حملات تزریق پرامپت نیاز خواهد بود.